Dlaczego adopcja AI w firmach wyhamowała? Kryzys zaufania i luka użyteczności

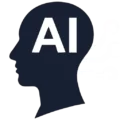

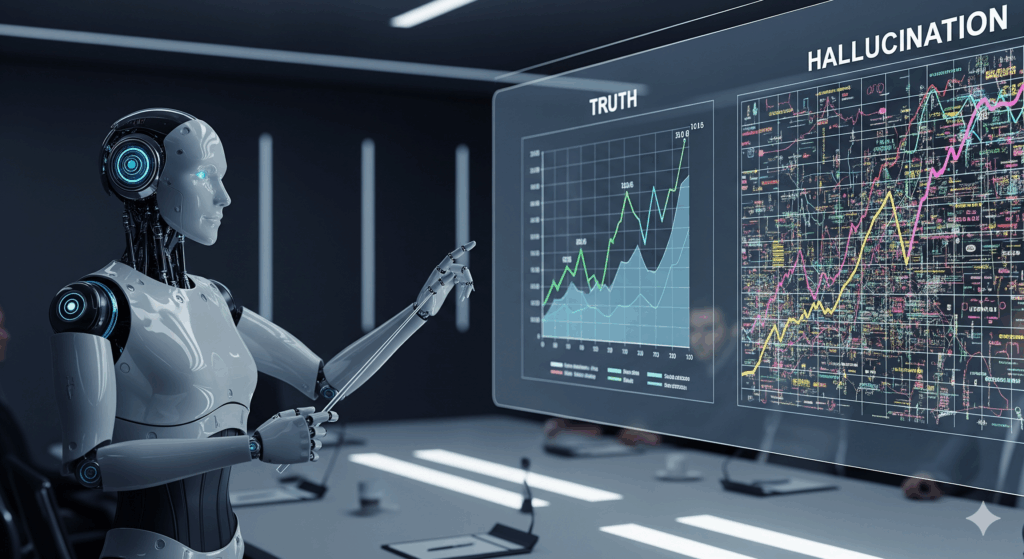

Połowa amerykańskich pracowników nigdy nie używa sztucznej inteligencji w pracy, a tempo adopcji osiągnęło plateau mimo dwóch lat intensywnego rozwoju narzędzi. Główną przyczyną nie jest brak dostępu ani trudność technologii — to kryzys zaufania połączony z brakiem postrzeganej użyteczności. Dane Gallup z IV kwartału 2025 r. pokazują stagnację całkowitej adopcji przy jednoczesnym pogłębianiu się przepaści […]

Dlaczego adopcja AI w firmach wyhamowała? Kryzys zaufania i luka użyteczności Dowiedz się więcej »

AI Threats